-

Prolog vs. Lisp: Explorando a Programação Lógica e Funcional

A escolha da linguagem de programação certa pode fazer toda a diferença no desenvolvimento de aplicativos complexos e sistemas inteligentes. Neste post, vamos mergulhar na comparação entre duas abo...

-

Haskell vs. OCaml: Escolhendo a Linguagem Funcional Ideal para o seu Projeto

Na era da computação moderna, onde a eficiência e a confiabilidade são cruciais, a escolha da linguagem de programação certa pode fazer toda a diferença. Neste artigo, vamos explorar as característ...

-

Dylan vs. Smalltalk: Programação Dinâmica e Orientada a Objetos

Quando se trata de linguagens de programação, a diversidade é abundante, cada uma com suas próprias características, forças e aplicações específicas. Neste blog, vamos mergulhar na comparação entre...

-

JRuby vs. Groovy: Desenvolvimento JVM Dinâmico

A escolha entre JRuby e Groovy pode ser um desafio para desenvolvedores que trabalham em ambientes Java. Ambas as linguagens oferecem vantagens únicas, mas é importante entender as diferenças para ...

-

V vs. Zig: Linguagem Certa para Desenvolvimento de Sistemas e Segurança

Na era digital em constante evolução, a escolha da linguagem de programação certa se torna cada vez mais crucial para o desenvolvimento de sistemas eficientes e seguros. Neste artigo, vamos explora...

-

Crystal vs. Nim: Desenvolvimento de Sistemas e Performance

O mundo do desenvolvimento de software está em constante evolução, e as linguagens de programação desempenham um papel fundamental nesse cenário. Duas linguagens que têm ganhado destaque são o Crys...

-

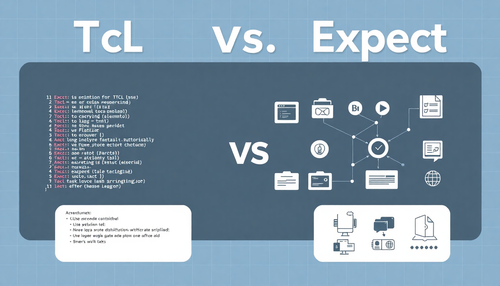

Tcl vs. Expect: Explorando as diferenças na Automação de Tarefas

A evolução da tecnologia trouxe consigo uma série de ferramentas e linguagens de programação que visam facilitar a automatização de tarefas. Neste cenário, duas opções se destacam: Tcl (Tool Comman...

-

Idris vs. Agda: Explorando a Programação Funcional e a Tipagem Dependente

No mundo em constante evolução da tecnologia, a busca por linguagens de programação cada vez mais poderosas e seguras é uma prioridade. Neste cenário, duas linguagens se destacam: Idris e Agda. Amb...

-

Jai vs. Odin: Linguagem Certa para Desenvolvimento de Sistemas de Alto Desempenho

Quando se trata de desenvolvimento de sistemas e aplicações de alto desempenho, a escolha da linguagem de programação certa pode fazer toda a diferença. Neste post, vamos explorar duas opções promi...

-

Jai vs. V: Qual a melhor linguagem para desenvolvimento de sistemas de alto desempenho?

A escolha da linguagem de programação certa pode fazer uma grande diferença no desempenho e eficiência de um sistema. Neste post, vamos comparar duas linguagens emergentes, Jai e V, que estão se de...

-

Pony vs. Ponylang: Concorrência e o Desenvolvimento de Sistemas

A indústria de tecnologia está em constante evolução, e as linguagens de programação desempenham um papel fundamental nesse cenário. Duas linguagens que têm chamado a atenção são o Pony e o Ponylan...

-

Q# vs. Qiskit: Diferenças no Desenvolvimento de Computação Quântica

A computação quântica tem sido um campo em rápida evolução, com diversas linguagens e frameworks surgindo para permitir que desenvolvedores explorem esse novo paradigma computacional. Neste post, v...

-

TypeScript vs. Dart: Quam melhor para Desenvolvimento de Aplicativos Web e Móveis?

A escolha entre TypeScript e Dart é uma decisão importante para qualquer desenvolvedor que esteja construindo aplicativos web e móveis. Ambas as linguagens oferecem recursos poderosos e têm suas pr...

-

Q# vs. Qiskit: Diferenças no Desenvolvimento de Computação Quântica

A computação quântica tem sido um campo em rápida evolução, com diversas linguagens e frameworks surgindo para atender às necessidades dos desenvolvedores. Neste artigo, vamos explorar duas das pri...

-

AutoIt vs. AutoHotkey: Ferramentas Poderosas para Automação de Tarefas no Windows

Neste mundo digital em constante evolução, a necessidade de automatizar tarefas rotineiras e aumentar a produtividade é cada vez mais evidente. Duas ferramentas que se destacam nesse cenário são o ...

-

C++20 vs. Rust: Desenvolvimento de Sistemas e Segurança

A evolução das linguagens de programação é um tópico fascinante, especialmente quando se trata de comparar duas abordagens tão distintas como C++20 e Rust. Ambas as linguagens desempenham papéis cr...

-

Haxe vs. CoffeeScript: Melhor Opção para Desenvolvimento Multiplataforma

Na era digital em constante evolução, a escolha da linguagem de programação certa pode fazer toda a diferença no sucesso de um projeto. Duas opções que têm se destacado no cenário do desenvolviment...

-

Lua vs. JavaScript: Linguagens para Desenvolvimento de Jogos e Scripts

Quando se trata de desenvolvimento de jogos e scripts, a escolha da linguagem de programação certa pode fazer toda a diferença. Duas opções populares neste cenário são Lua e JavaScript, cada uma co...

-

Haxe vs. Dart: Escolhendo a melhor opção para Desenvolvimento Multiplataforma

Quando se trata de desenvolvimento multiplataforma, duas linguagens de programação se destacam: Haxe e Dart. Ambas oferecem soluções poderosas para criar aplicativos que funcionam em diferentes pla...

-

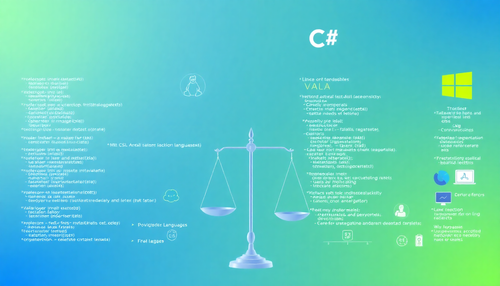

Vala vs. C#: Linguagem para Desenvolvimento de Aplicativos Linux e Windows

Ao escolher uma linguagem de programação para o desenvolvimento de aplicativos, é importante considerar as características e os recursos oferecidos por cada uma. Neste artigo, vamos comparar duas l...

-

Groovy vs. Java: Desenvolvimento de Aplicativos Dinâmicos

Quando se trata de desenvolvimento de aplicativos, os programadores têm uma variedade de opções à sua disposição. Duas linguagens de programação que têm se destacado nesse cenário são o Groovy e o ...

-

F# vs. Scala: Programação Funcional e Orientada a Objetos

A escolha da linguagem de programação certa pode fazer uma grande diferença no sucesso de um projeto. Neste artigo, vamos explorar as características e aplicações de duas linguagens populares: F# e...

-

Common Lisp vs. Scheme: Explorando a Programação Funcional Acadêmica

A programação funcional tem sido um campo fascinante na ciência da computação, com linguagens como Common Lisp e Scheme desempenhando papéis importantes no desenvolvimento dessa paradigma. Neste ar...

-

Groovy vs. JRuby: Escolhendo a Linguagem Dinâmica Ideal para o seu Projeto JVM

A escolha da linguagem de programação certa pode fazer uma grande diferença no sucesso de um projeto de software. Quando se trata de desenvolvimento JVM (Java Virtual Machine), duas opções dinâmica...

-

Smalltalk vs. Ruby: Qual a Melhor Linguagem de Programação Orientada a Objetos?

Quando se trata de desenvolvimento de software, a escolha da linguagem de programação é fundamental. Duas opções que têm se destacado no cenário do desenvolvimento orientado a objetos são o Smallta...

-

Dylan vs. Common Lisp: Explorando a Programação Dinâmica e Funcional

A escolha da linguagem de programação certa pode fazer toda a diferença no desenvolvimento de sistemas complexos. Neste artigo, vamos explorar duas opções poderosas: Dylan e Common Lisp. Ambas ofer...

-

Pascal vs. Delphi: Linguagem para Desenvolvimento de Aplicativos Desktop

Na era digital em constante evolução, a escolha da linguagem de programação certa pode fazer toda a diferença no desenvolvimento de aplicativos desktop. Duas opções que têm se destacado nesse cenár...

-

OCaml vs. F#: Comparando Linguagens Funcionais e de Tipagem Estática

Na era da computação moderna, onde a eficiência e a confiabilidade são cruciais, as linguagens de programação funcionais e de tipagem estática têm se destacado como opções poderosas. Neste artigo, ...

-

TypeScript vs. JavaScript: Tipagem Estática e Escalabilidade

Em 2025, a adoção de TypeScript deve aumentar em projetos de grande escala. Como uma superset do JavaScript, o TypeScript adiciona recursos de tipagem estática, melhorando a segurança e escalabilid...

-

Go vs. Python: Concorrência e Simplicidade

Em 2025, a escolha entre Go e Python para desenvolvimento de back-end e sistemas distribuídos se torna cada vez mais relevante. Ambas as linguagens possuem características únicas que as tornam atra...

-

Go vs. Java: Concorrência e Escalabilidade

Go (ou Golang) e Java são duas linguagens amplamente utilizadas para o desenvolvimento de aplicações robustas e de alta performance. No entanto, quando o assunto é concorrência e escalabilidade, ca...

-

Rust vs. C++: Segurança vs. Performance

Em 2025, a escolha entre Rust e C++ continua sendo um tópico de grande debate entre desenvolvedores de software. Ambas as linguagens são conhecidas por sua ênfase na performance, mas Rust se destac...

-

Kotlin vs. Java: Desenvolvimento Android Moderno em 2025

Em 2025, o desenvolvimento de aplicativos Android continua a evoluir rapidamente, com a linguagem Kotlin consolidando sua posição como a escolha preferida dos desenvolvedores. Desde que a Google a ...

-

Julia vs. Python: Velocidade e Análise de Dados

Em 2025, a linguagem de programação Julia está ganhando cada vez mais atenção no mundo da análise de dados e ciência de dados. Embora Python ainda seja a linguagem dominante nessas áreas, Julia vem...

-

COBOL vs. Visual Basic: Legado e Desenvolvimento Rápido

Nos dias atuais, as empresas enfrentam um desafio constante de equilibrar a necessidade de manter sistemas legados robustos e a demanda por soluções de desenvolvimento rápido e inovadoras. Neste ce...

-

C# vs. F#: Linguagem Certa para o seu Projeto

Como desenvolvedores, enfrentamos constantemente o desafio de escolher a linguagem de programação mais adequada para nossos projetos. Neste artigo, vamos explorar as diferenças entre C# e F#, duas ...

-

Kotlin vs. Swift: Qual a Melhor Opção para Desenvolvimento Móvel?

O desenvolvimento móvel é um campo em constante evolução, com duas linguagens de programação dominantes: Kotlin e Swift. Ambas têm suas próprias forças e fraquezas, e a escolha entre elas pode ter ...

-

MATLAB vs. R: Qual a melhor ferramenta para análise de dados e simulações?

A escolha entre MATLAB e R é uma decisão importante para profissionais que trabalham com análise de dados, modelagem e simulações. Ambas as ferramentas possuem pontos fortes e fracos, e a seleção d...

-

Elixir vs. Java: Concorrência e Desenvolvimento de Aplicativos

A escolha da linguagem de programação certa pode fazer uma grande diferença no desenvolvimento de aplicativos, especialmente quando se trata de concorrência e escalabilidade. Neste artigo, vamos co...

-

Clojure vs. Kotlin: Linguagem para seu Desenvolvimento JVM e Concorrência

Na era da computação moderna, onde a complexidade dos sistemas e a necessidade de escalabilidade são cada vez mais desafiadoras, a escolha da linguagem de programação certa pode fazer toda a difere...

-

Bash vs. Perl: Linguagens de Scripting e Processamento de Texto

Em um mundo cada vez mais automatizado, a escolha da linguagem de script certa pode fazer toda a diferença na eficiência e produtividade de suas tarefas. Neste artigo, vamos explorar as característ...

-

Python vs. Perl: Análise de Dados e Scripting

A escolha entre Python e Perl é uma decisão importante para muitos profissionais que trabalham com análise de dados e automação de tarefas. Ambas as linguagens têm seus pontos fortes e aplicações e...

-

Haskell vs. Scala: Programação Funcional e Tipagem Estática

Na era da computação moderna, onde a eficiência e a escalabilidade são cruciais, a escolha da linguagem de programação certa pode fazer toda a diferença. Duas opções que se destacam nesse cenário s...

-

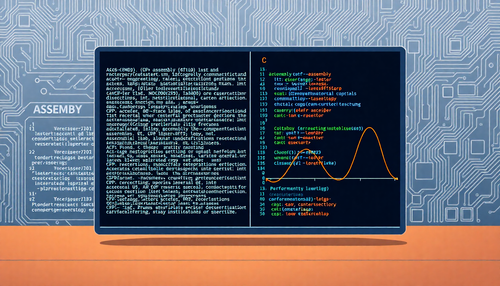

Assembly vs. C: Baixo Nível e Performance

A escolha entre Assembly e C é uma decisão importante para desenvolvedores que precisam lidar com requisitos de alto desempenho e controle de baixo nível. Ambas as linguagens oferecem vantagens e d...

-

Scratch vs. Python: Qual a Melhor Linguagem de Programação para Iniciantes?

Quando se trata de aprender a programar, existem diversas opções de linguagens disponíveis, cada uma com suas próprias características e aplicações. Duas das linguagens mais populares para iniciant...

-

PHP vs. Ruby: Qual a Melhor Opção para Desenvolvimento Web Dinâmico?

Quando se trata de desenvolvimento web dinâmico, duas linguagens de programação se destacam: PHP e Ruby. Ambas têm suas próprias forças e fraquezas, e a escolha entre elas pode fazer uma grande dif...

-

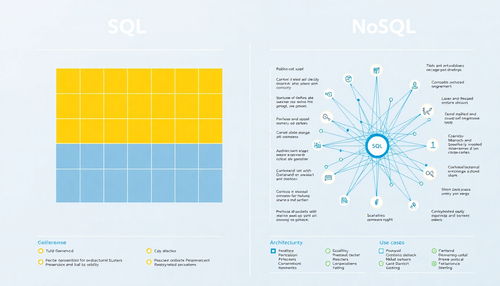

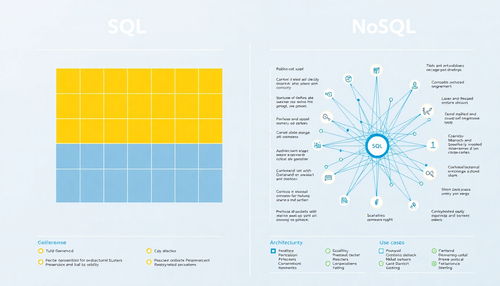

SQL vs. NoSQL: Solução de Gerenciamento de Dados para sua Empresa

Na era digital em que vivemos, a gestão eficiente de dados tornou-se fundamental para o sucesso de qualquer negócio. Empresas de todos os tamanhos e setores enfrentam o desafio de armazenar, proces...

-

C vs. Fortran: Desempenho e Simulações Científicas

A escolha da linguagem de programação certa pode fazer uma grande diferença no desempenho e eficiência de aplicações científicas e de engenharia. Duas opções populares neste contexto são C e Fortra...

-

Integração da Inteligência Artificial no Desenvolvimento de Software: Impulsionando a Inovação e a Eficiência

Em 2025, a Inteligência Artificial (IA) se tornou uma ferramenta indispensável no desenvolvimento de software, transformando a maneira como os programadores trabalham e as soluções que eles criam. ...

-

Linguagens de Programação em Ascensão: Explorando as Tendências Emergentes

A indústria de tecnologia está em constante evolução, com novas linguagens de programação surgindo e ganhando popularidade a cada ano. Neste blog, vamos explorar algumas das linguagens de programaç...

-

Ecossistema de Aplicativos: 5 coisas essenciais para se ter dominio

Os ecossistemas de aplicativos estão se expandindo e se tornando mais complexos com o surgimento de aplicativos baseados em IA, esforços de modernização e novas iniciativas. Embora eu não ache que ...

-

Tarifa temporária de 12% da Índia sobre importações de aço

Em 21 de abril de 2025, o governo da Índia anunciou a implementação de uma tarifa temporária de 12% sobre as importações de aço no país. Esta medida visa proteger a indústria siderúrgica doméstica ...

-

Produção brasileira de aço bruto cresce 6,6% em março de 2025

A indústria siderúrgica brasileira apresentou resultados animadores no primeiro trimestre de 2025. Segundo dados divulgados pelo Aço Brasil, a produção de aço bruto no país em março alcançou 2,944 ...

-

Queda contínua da Confiança da Indústria do Aço no Brasil

A indústria do aço no Brasil enfrenta um cenário de cautela e incertezas, com o Indicador de Confiança da Indústria do Aço (ICIA) caindo pelo sexto mês consecutivo em abril, atingindo 31,6 pontos. ...

-

Exportações brasileiras de aço para os EUA crescem apesar das tarifas

Mesmo com a sobretaxa de 25% imposta pelos EUA, as exportações brasileiras de aço e automóveis para o mercado norte-americano cresceram até 20,5% no primeiro trimestre de 2025, mostrando a resiliên...

-

Notícias do Setor Siderúrgico: Recordes, Preços e Exportações

O setor siderúrgico global continua a apresentar movimentações significativas, com destaque para alguns fatos recentes que impactam diretamente o mercado internacional de aço. Vamos analisar alguma...

-

Ibovespa acelera alta e dólar cai com guerra comercial em foco

O mercado financeiro brasileiro registrou uma sessão positiva nesta segunda-feira (17), com o Ibovespa, principal índice da B3, subindo 0,93% e chegando a 129.507 pontos. Ao mesmo tempo, o dólar à ...

-

Big Techs perdem mais de 10% após o anúncio do 'Tarifaço' dos EUA

As principais empresas de tecnologia dos Estados Unidos, conhecidas como "Big Techs", registraram quedas superiores a 10% em suas ações desde o anúncio do aumento das tarifas comerciais pelo govern...

-

Mercado financeiro eleva previsão para expansão da economia brasileira em 2025

O cenário econômico brasileiro tem sido alvo de constante atenção e análise por parte dos especialistas do mercado financeiro. Recentemente, o Boletim Focus do Banco Central do Brasil elevou a prev...

-

Banco Central Europeu reduz juros e alerta para incertezas em meio a tarifas

O Banco Central Europeu (BCE) anunciou mais um corte na taxa básica de juros, a sétima redução em um ano, em uma tentativa de sustentar a economia da zona do euro diante das incertezas geradas pela...

-

Economia global sob pressão pode desacelerar para 2,3%, sinaliza ONU

A economia global enfrenta uma conjuntura desafiadora, com incertezas que podem levar a uma desaceleração do crescimento para apenas 2,3% em 2025, de acordo com as projeções da Organização das Naçõ...

-

Petrobras anuncia redução no preço do diesel para distribuidoras

A Petrobras, a maior empresa de energia do Brasil, anunciou hoje uma redução no preço do diesel para as distribuidoras a partir de amanhã. Essa medida vem em um momento crucial para a economia bras...

-

China lança Pacote de Estímulos para Estabilizar Produção Siderúrgica

O governo chinês anunciou recentemente um pacote de medidas para apoiar a indústria siderúrgica do país, visando estabilizar a produção e manter os empregos no setor. Essa iniciativa surge em meio ...

-

Exportações brasileiras de minério de ferro crescem 5% em março, diz Vale

As exportações brasileiras de minério de ferro registraram um aumento de 5% em março de 2025, de acordo com os dados divulgados pela Vale, uma das principais mineradoras do país. Esse crescimento r...

-

Aço Inoxidável em Alta: Entenda o Crescimento da Demanda no Mercado Brasileiro

Em 2025, o mercado brasileiro de aço inoxidável experimentou um crescimento significativo, com uma alta de 12% na demanda. Esse aumento é impulsionado por diversos setores-chave da economia, como a...

-

Queda na Produção e Consumo da Siderurgia Brasileira em Março

Em março de 2025, a indústria siderúrgica brasileira enfrentou um período desafiador, com uma queda significativa tanto na produção quanto no consumo de aço. Os dados revelam que a produção de aço ...

-

Confiança da indústria brasileira atinge o menor nível desde 2020

Em 2025, a confiança dos industriais brasileiros atingiu o menor patamar desde 2020, de acordo com uma pesquisa realizada pela Confederação Nacional da Indústria (CNI). Esse cenário reflete as ince...

-

Exportação de Equipamentos Agrícolas cresce 15% com destaque para Componentes em Aço

O Brasil registra um aumento expressivo na exportação de máquinas e equipamentos agrícolas, especialmente aqueles que utilizam componentes em aço de alta performance, atendendo à demanda global por...

-

Aço e alumínio respondem por quase 40% das exportações brasileiras para os EUA em 2025

Nos três primeiros meses de 2025, 47,5% do valor das exportações brasileiras de aço e alumínio foram destinados aos Estados Unidos. Apesar da tarifa de 25% imposta pelo governo americano, o setor s...

-

Indústria brasileira aposta no diálogo para reverter taxação do aço nos EUA

A indústria brasileira de aço está confiante de que o diálogo com o governo dos Estados Unidos pode reverter a recente imposição de uma tarifa de 25% sobre as exportações de aço brasileiro para o p...

-

Brasil tem impactos Negativos e Positivos com as tarifas entre EUA e China

Consequências para o Brasil e os principais setores atingidos pelas tarifas impostas entre Estados Unidos e China

A guerra comercial travada entre Estados Unidos e China, com imposição mútua de tar...

-

Tarifas entre EUA e China: Setores atigindos e Impactos Econômicos

A guerra comercial entre Estados Unidos e China representa uma das mais intensas disputas econômicas da história moderna. Com a imposição de tarifas altíssimas sobre produtos importados, tanto os E...

-

Inovações em Ferramentas Agrícolas com Aço

A agricultura moderna depende cada vez mais de ferramentas eficientes e duráveis para garantir a produtividade e o sucesso das operações no campo. Nesse contexto, o aço tem se destacado como um mat...

-

Agricultura 5.0: Revolução Tecnológica no Campo

A agricultura, ao longo dos séculos, tem passado por transformações significativas, impulsionadas pela evolução tecnológica. Desde a mecanização da lavoura até a introdução de técnicas de precisão,...

-

Aço no Agronegócio - Equipamentos, Armazenagem, Maquinário e Inovação

O aço é um material fundamental no agronegócio, desempenhando um papel crucial em diversas aplicações. Sua resistência, durabilidade e versatilidade o tornam indispensável para a indústria agrícola...

-

Estruturas de Armazenagem em Aço que transformam o Agronegócio

O agronegócio é um setor fundamental para a economia global, responsável por alimentar bilhões de pessoas em todo o mundo. Nesse contexto, as estruturas de armazenagem em aço desempenham um papel c...

-

Importações Brasileiras de Aço Devem Crescer em 2025

De acordo com o Instituto Nacional dos Distribuidores de Aço (INDA), as importações brasileiras de aço devem crescer cerca de 11% em 2025. Esse aumento é impulsionado pela competitividade do mercad...

-

Nova Política Industrial Brasileira Impulsiona o Mercado Nacional de Aço Inoxidável

O Brasil, em 2023, lançou a Nova Indústria Brasil (NIB), uma política industrial ambiciosa voltada para a inovação e a sustentabilidade até 2033. Essa iniciativa tem tido um impacto significativo e...

-

Indústria do Aço enfrenta Desafios em 2025: Queda na Produção e Vendas Projetada

A indústria siderúrgica brasileira enfrenta um cenário desafiador em 2025, com projeções de queda na produção de aço bruto e nas exportações de laminados. De acordo com as estimativas, a produção d...

-

A Indústria Brasileira enfrenta desafios em meio a uma demanda mais fraca

A indústria brasileira, incluindo o setor siderúrgico, está enfrentando uma demanda mais fraca do que o esperado. Os dados mostram que a produção de aço no Brasil caiu 1,6% em fevereiro em relação ...

-

Tarifas de 25% sobre Aço e Alumínio nos EUA: Impactos para o Brasil

Em março de 2025, o governo dos Estados Unidos implementou tarifas de 25% sobre todas as importações de aço e alumínio. Essa medida teve um impacto significativo no Brasil, que é o segundo maior fo...

-

Produção de Aço no Brasil registra crescimento em Fevereiro de 2025

A indústria siderúrgica brasileira deu sinais de recuperação em fevereiro de 2025, com a produção de aço bruto atingindo 2,7 milhões de toneladas, um aumento em relação às 2,6 milhões de toneladas ...

-

Brasil Planeja Investir US$ 20 Bilhões na Expansão do Setor Siderúrgico

O setor siderúrgico brasileiro anunciou planos ambiciosos para investir US$ 20 bilhões em projetos de expansão e modernização até 2030. Essa iniciativa visa posicionar o Brasil como líder na produç...

-

Setor Automotivo impulsiona demanda por Aço no Brasil

O setor automotivo brasileiro vem registrando um crescimento significativo nos últimos anos, impulsionando a demanda por aço laminado e componentes estruturais utilizados na fabricação de veículos....

-

Indústria Brasileira acredita em diálogo para reverter Taxação do Aço

A indústria brasileira está confiante de que o diálogo com os Estados Unidos pode reverter a recente taxação de 25% sobre as exportações de aço do Brasil para o mercado americano. Essa medida, anun...

-

7 Medidas do Governo para mitigar os Efeitos da Selic Alta no Setor Industrial

Em 2025, o cenário econômico brasileiro é marcado por uma Selic (taxa básica de juros) elevada, impactando diretamente o setor industrial. Diante desse desafio, o governo federal tem buscado implem...

-

Redução da Produção de Aço na China impacta nas Mineradoras Brasileiras

A redução da produção de aço na China está impactando as mineradoras brasileiras de várias maneiras. Como o maior consumidor de minério de ferro do mundo, a queda na produção siderúrgica chinesa si...

-

Como o Controle dos Gastos Públicos beneficia diferentes Setores Industriais

O controle dos gastos públicos é um tema recorrente nas discussões sobre políticas econômicas. Embora muitas vezes visto como uma medida restritiva, essa abordagem pode trazer benefícios significat...

-

Desaceleração no Custo da Construção: Análise do INCC-M

O setor da construção civil é um importante motor da economia brasileira, com impactos significativos em diversos segmentos industriais. Nesse contexto, o acompanhamento dos índices de custo da con...

-

Expansão do Porto de Paranaguá: Aumento de Capacidade e Impacto no Agronegócio Brasileiro

O Porto de Paranaguá, localizado no sul do Brasil, desempenha um papel fundamental no escoamento da produção agrícola do país. Recentemente, a administração portuária anunciou uma importante expans...

-

Prioridades da Indústria para o Congresso: Licenciamento Ambiental, Economia Circular e Inteligência Artificial

A indústria brasileira apresentou suas principais prioridades ao Congresso Nacional, destacando três temas fundamentais para impulsionar a competitividade e a sustentabilidade do setor nos próximos...

-

CMA CGM recebe Primeiro Navio Movido a Metanol

O grupo CMA CGM, um dos principais operadores de transporte marítimo do mundo, acaba de receber seu primeiro navio porta-contêineres movido a metanol. Essa inovação representa um marco importante n...

-

Brasil lidera Exportações Globais de Commodities Agrícolas

O Brasil se estabeleceu como o principal exportador mundial de commodities agrícolas, superando os Estados Unidos neste segmento. Esse crescimento expressivo nas exportações do agronegócio brasilei...

-

Confiança da Indústria Estável: Análise do Índice de Confiança da Indústria (ICI) do FGV IBRE

O Índice de Confiança da Indústria (ICI) do FGV IBRE permaneceu estável em março, com uma leve variação de 0,1 ponto, alcançando 98,4. Essa estabilidade sugere que as expectativas dos empresários e...

-

Mercado de Aço em 2025: Uma Visão Geral

O mercado de aço no mundo está passando por um período de ajustes, com influências significativas na demanda e nos preços. Aqui está uma visão geral da situação atual:

Demanda de Aço

Crescimento Gl...

-

Importância da Indústria na Economia Global

A economia da indústria é um setor vital que transforma matérias-primas em bens e serviços, desempenhando um papel fundamental na produção e no fornecimento de empregos em todo o mundo. Ela é class...

-

Principais Indústrias que impulsionam a Economia Brasileira

As maiores indústrias do Brasil são líderes em seus respectivos setores e desempenham um papel crucial na economia nacional. Elas variam desde a indústria de petróleo e gás até a siderurgia, alimen...

-

Complexo Industrial do ABCD: O Coração Batente da Indústria Brasileira

O Complexo Industrial do ABCD, localizado na região metropolitana de São Paulo, é reconhecido como o maior polo industrial do Brasil. Abrangendo os municípios de Santo André, São Bernardo do Campo,...

-

Região Sudeste: O Coração Industrial do Brasil

A região Sudeste do Brasil é indiscutivelmente o coração industrial do país. Abrangendo os estados de Minas Gerais, Espírito Santo, Rio de Janeiro e São Paulo, essa área geográfica concentra a maio...

-

Industrialização Tardia e seus Desafios

A industrialização tardia é um fenômeno complexo que tem marcado o desenvolvimento econômico de muitos países em todo o mundo. Esse processo, caracterizado pela dependência tecnológica, investiment...