Armado com um modelo GPT personalizado, um analista procurou simplificar a tarefa assustadora de consultar dados financeiros volumosos. Foi, à primeira vista, um golpe de gênio — uma ferramenta inovadora projetada para tornar a análise de dados acessível para aqueles sem experiência em codificação.

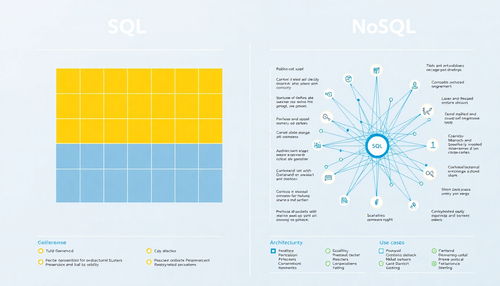

Chega de lutar com Python ou SQL — apenas o poder da linguagem natural na ponta dos dedos. O potencial era enorme. Mas o que começou como uma inovação promissora tomou um rumo bizarro e decepcionante quando a própria rigidez do analista sufocou o que poderia ter sido um salto ainda maior.

O Projeto Promissor

O projeto tinha mérito inegável. Ao carregar um conjunto de dados complexo sobre gastos históricos e alocações orçamentárias em um modelo GPT finamente ajustado, o analista transformou um assunto tradicionalmente opaco em algo acessível e compreensível.

O modelo podia responder perguntas em inglês simples, tornando possível para qualquer um interrogar dados orçamentários sem precisar de um conjunto de habilidades técnicas. Era uma ferramenta que prometia democratizar a análise de dados, oferecendo uma janela para os gastos públicos que antes estavam fechados para a maioria.

Mas a excitação na sala diminuiu quando uma questão crítica foi levantada: como saber se o chatbot é preciso?

A Confiança Cega do Analista

Com surpreendente ingenuidade, o analista respondeu que era impossível que o bot estivesse errado. "Ele está gerando código Python", ele afirmou confiantemente, como se o ato de gerar código automaticamente garantisse a validade dos resultados. Foi um momento de consternação para aqueles que assistiam. A afirmação não era apenas tecnicamente falha, mas expunha um mal-entendido fundamental de como a IA e a codificação funcionam.

Qualquer profissional de dados experiente entende que gerar código não é o mesmo que garantir sua correção. O código Python pode facilmente abrigar falhas lógicas, mesmo que seja sintaticamente perfeito. O modelo, ao interpretar e responder aos dados enviados, pode deturpar números, fazer suposições incorretas ou simplesmente produzir saídas errôneas devido à qualidade dos dados em que foi treinado. No entanto, o analista se manteve firme, incapaz de considerar que seu modelo poderia produzir erros — um tipo de visão de túnel que pode ser perigosa no trabalho orientado a dados.

A Oportunidade Perdida

Mas não foi aí que a verdadeira decepção estava. Afinal, todos podem julgar mal suas próprias criações às vezes. O momento mais preocupante veio quando alguém sugeriu um aprimoramento que poderia ter elevado o projeto: por que não usar o chatbot para gerar perguntas instigantes sobre o orçamento? Se o modelo tivesse sido treinado em todos esses dados, certamente poderia ser usado para estimular novas linhas de investigação e sugerir áreas que justificassem um exame mais profundo.

A reação do analista foi, francamente, desconcertante. Ele rejeitou categoricamente a sugestão, insistindo que quaisquer perguntas que o chatbot pudesse gerar seriam aleatórias e careceriam de relevância. Era como se ele tivesse esquecido completamente o contexto que havia dado ao modelo, o que o tornava perfeitamente capaz de produzir perguntas perspicazes e baseadas em dados. Sua visão do modelo se limitava a ser uma ferramenta de consulta de dados — nada mais. Em vez de ver a IA como uma parceira na análise, ele fechou sua mente, recusando-se a entreter a ideia de que ela poderia ser uma colaboradora na geração de novas ideias.

Limitando o Potencial da IA

Foi um ponto de virada — o analista havia criado algo que poderia revolucionar a maneira como as pessoas interagiam com dados, apenas para se recusar a deixá-lo evoluir além de sua própria visão estreita. Ele havia construído um carro, mas se recusou a considerar dirigi-lo em qualquer lugar novo. O modelo GPT, que poderia ter capacitado usuários não técnicos a explorar o orçamento, analisar tendências e até mesmo fazer brainstorming de questões inovadoras, foi reduzido a um mecanismo de busca glorificado.

Ao encerrar a própria possibilidade de usar IA como uma ferramenta para exploração, o analista efetivamente minou o potencial transformador de seu próprio projeto.

O que torna essa reviravolta realmente decepcionante não é apenas a oportunidade perdida, mas o que ela diz sobre nossa mentalidade mais ampla diante das novas tecnologias. Há uma tendência a ver a IA como uma mera extensão do que já fazemos — uma calculadora mais rápida, um roteirista mais eficiente, uma interface de consulta de dados simplificada.

Ao confinar a IA a aplicações tão estreitas, fazemos um desserviço a ela, mas, mais importante, nos limitamos. Não conseguimos vê-la como uma ferramenta que pode nos ajudar a pensar, desafiar nossas suposições e até mesmo sugerir caminhos que talvez não tivéssemos considerado.

Conclusão

Este analista de dados chegou longe, de fato, com seu modelo GPT personalizado. Ele demonstrou como novas tecnologias podem reduzir barreiras, permitindo que mais pessoas se envolvam com conjuntos de dados complexos. Mas então, quando ele estava prestes a romper com algo verdadeiramente revolucionário, seu cérebro desligou. Ele parou de inovar. Ele se recusou a imaginar. E ele descartou o maior trunfo da IA: sua capacidade de gerar novas perspectivas, novas conexões e novas perguntas que os humanos nunca teriam formulado por conta própria.

A lição aqui é clara. Na era da IA, o maior desafio não é construir modelos mais capazes — é manter a mente aberta. À medida que expandimos os limites da tecnologia, precisamos garantir que não nos encurralemos em pensamentos ultrapassados. Porque quando paramos de sonhar e explorar, mesmo a IA mais poderosa não pode nos ajudar a abrir novos caminhos.